今や毎日のように自動運転や自律走行ロボットの話題を目にするようになりました。これらを支える一部にSLAM(すらむ、Simultaneous Localization and Mapping)と呼ばれる技術があります。SLAMは、移動する物体(ロボットや機械)に取り付けられたカメラやLiDARなどのセンサーから得られる情報を基に、周囲の環境マップを作りながらデバイス自身の位置を推定できる技術です。例えるならば、引っ越し先や旅先で自分で歩きながら道や建物の配置を確認し、その中で今自分がどこにいるのか、位置関係を理解するようなイメージです。

弊社(テガラ株式会社)の取り扱い製品にもSLAM技術に関連した製品が多くございます。

今回はそんな製品を、SLAMの実現に使用されている2種類の技術と共にご紹介します。

目次

SLAM技術はどんなところで使われているのか

SLAM技術が関連した製品はいくつもあり、身近な例ですと部屋の中を自動で動くお掃除ロボットがあげられます。このほかニュースなどで度々取り上げられる自律輸送ソリューション(Amazonなどの倉庫で活用)、ドローン・UAV(無人航空機)等の自動操縦による荷物の配達、自動運転車や火星探査ローバーにもSLAM技術が使われています。

SLAMには、カメラで撮影した画像情報を基にするVisual SLAMと、LIDARで計測した点群データを基にするLiDAR SLAM の2つがあり、ともに注目が高いです。それぞれの技術に分けて、代表的な製品をご紹介いたします。

Visual SLAMとは

Visual SLAM(Simultaneous Localization and Mapping)は、カメラで撮影された映像から、環境(地図、場所)の3次元情報とカメラの位置姿勢を同時に推定する技術です。カメラには、単眼カメラ、ステレオカメラ、RGB-Dカメラ(D=Depth、深度)などが利用されます。

・単眼カメラ: デジカメやスマートフォンのような典型的なカメラ。通常、1つのレンズを使用して、2Dの環境画像を作成。

・ステレオカメラ: 人間の目のように 2つのレンズ(2眼)を利用するカメラ。撮影した2枚の画像から奥行きを推定し、3D画像を作成。

・RGB-Dカメラ: 通常レンズに加えて深度センサーを利用するカメラ。実空間の視覚情報を計測し、3D画像を作成。

カメラの種類はたくさんありますので、ご用途に合わせご相談ください。

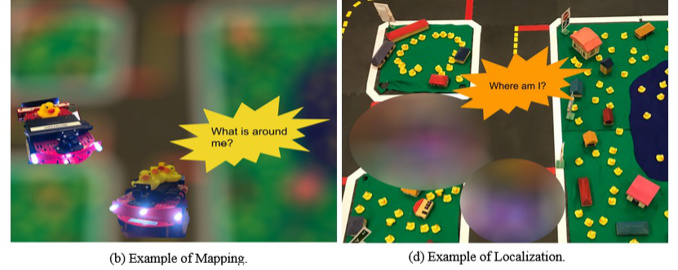

Visual SLAMのイメージ (MYNT EYEの場合)

以下は、Visul SLAM関連製品です。

Duckietown

Duckietownは、MIT(マサチューセッツ工科大学)発の、ロボット工学とAIを学ぶためのプラットフォームです。 小型の自動車両(Duckiebot)、道路、信号機、標識、障害物、 輸送を必要とする人(Duckies)、そして彼らが住む都市(Duckietown)で構成されています。

Duckietownを走行するDuckiebotには、1台の単眼カメラ(160°の広い視野と5Mピクセルの魚眼レンズ)を搭載し、撮影画像とカメラの位置姿勢を同時に推定。

自動運転技術に必要なドライバーに代わる制御システム(危険や障害物を察知し回避、そして安全に走行すること)を学ぶことができます。

| ■商品の詳細、お問い合わせはこちら Duckietown / ロボット工学を学習できるオープンソースのAIカー メーカー(Duckietown Foundation US, Inc.) Webサイト |

MYNT EYE Sシリーズ

MYNT EYE S シリーズは、Visual SLAM用に設計された3Dステレオカメラで、3次元データ作成のために、ビジョンセンサー、ストラクチャーライト、そして慣性ナビゲーションを組み合わせることができます。屋内および屋外環境への適用はもちろん、IRセンサー搭載したモデルでは、完全な暗闇であっても屋内の障害(壁)を識別することができます。

MYNT EYEに組み込まれた6軸IMUセンサーは、最大0.02 msのIMU同期精度をもち、視覚慣性オドメトリー(VIO, Visual Inertial Odometry)の技術開発や、3D空間での位置や姿勢を推定に役立ちます。

| ■商品の詳細、お問い合わせはこちら MYNT EYE S / IMU搭載3Dステレオカメラ(Mono/Color) メーカー(MYNT EYE) Webサイト |

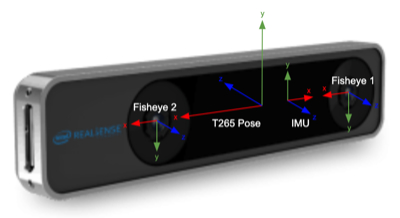

Intel RealSense Tracking Camera T265

T265トラッキングカメラは、2つの魚眼レンズセンサー(160°の視野角)、IMUセンサー、Intel Movidius Myriad 2と呼ばれる視覚処理装置(VPU)を搭載しています。独自のアルゴリズム(高精度な視覚慣性オドメトリー(VIO, Visual Inertial Odometry)とSLAM)は、視覚オドメトリー(VO)とIMU(I)オドメトリーが相互に補完しあい、SLAMアルゴリズム全体を実行します。ステレオイメージの分析、自律デバイスの姿勢推定、空間の向きと並進のデータなどを使用して、GPSを使用せずとも正確に追跡やナビゲートができます。

| ■商品の詳細、お問い合わせはこちら Intel RealSense Tracking Camera T265 / Intel製 V-SLAM トラッキングカメラ メーカー(Intel) Webサイト |

LiDAR SLAMとは

LiDAR (Light Detection and Ranging) というレーザーセンサー (距離センサー)を主に使用した方法です。より正確には、光の飛行時間(TOF, Time Of Flight)センサーカテゴリの一部で、障害物がセンサーからどれだけ離れているかを測定します。センサーは、温度、湿度、光、重量、距離などの物理パラメーターに関するデータを収集します。また、スキャナに軸数によって1D、2D、 3D に分かれますが、現在の主流は2D/3Dの2種類です。

・1D : ターゲット(障害物)とスキャナー間の距離を1軸(1次元)で測定。

・2D: 2次元(X軸とY軸)の点群データを取得するために、回転しながら1つのレーザービームを照射しターゲットまでの水平距離を測定。

・3D: 3次元( X、Y、Z軸)の点群データを取得するために、垂直軸に広がる複数のレーザービームを照射し、ターゲットの形状や位置などの測定。

お取り扱いしているLiDARは複数ございますため、ご用途に合わせご相談ください。

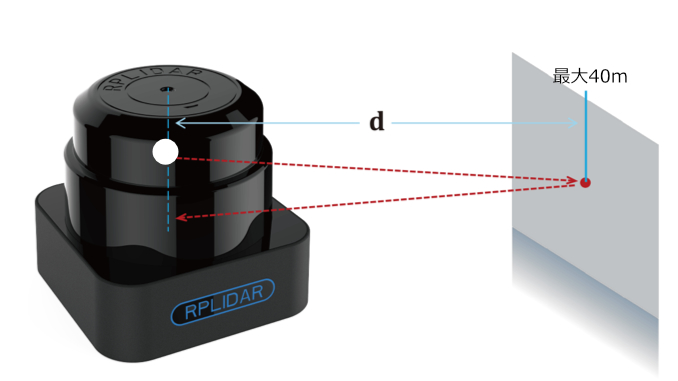

LiDAR SLAMのイメージ (RPLIDAR S1 の場合)

以下は、LiDAR SLAM関連製品です。

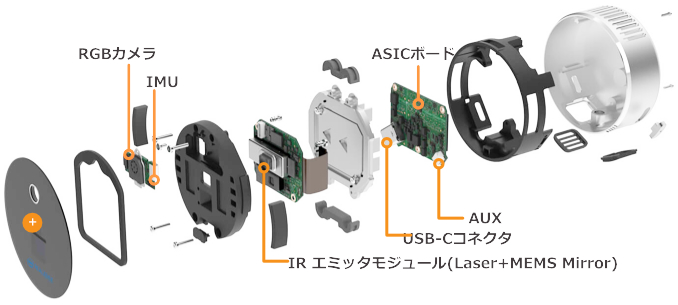

Intel RealSense LiDAR Camera L515

L515は、3D LiDARの中でも、小型で自由度の高いソリッドステート(Solid State)式の深度カメラで、高解像度・高精度の深度データを必要とする屋内アプリケーションの開発向けです。Intel社独自のMEMS(Micro-Electro-Mechanical System)*ミラースキャンの技術による、 高いレーザー出力効率の向上と、深度ストリーミングの低消費電力が特長です。

* MEMSは、ソリッドステート式の一種で、微小電子機械システムとも呼ばれています。

弊社で制作したL515の紹介動画の中でもLiDARについて触れていますのでご参照ください (1:36ごろ)

|

■商品の詳細、お問い合わせはこちら |

RPLIDAR S1

Slamtec社のRPLIDAR S1は、高さ51mmx幅と奥行き55.5mmととてもコンパクトなToF(Time of Flight)方式の360°レーザースキャナです。レンジスキャナーコアと、コアを高速で回転させる機械式動力部品で構成されており、時計回りに回転し360°スキャンを行います。対象物からの反射にも影響を受けにくく屋外での利用も可能です。小型ながらも半径最大40mの360度範囲を測定でき、幅広いアプリケーションに対応しています。

|

■商品の詳細、お問い合わせはこちら |

このほかにも、「 SLAM技術に関連した海外メーカー製のハードウェアを導入したい」というご要望がありましたら、ぜひお気軽にユニポスにご相談ください。

今回ご紹介した製品以外の、これまでに弊社で取り扱いのない製品でも、取り扱いの可否をお調べし、お見積りいたします。